Die Frage, die im Kundengespräch fiel

Neulich saß ich mit einem Kunden im KPI-Workshop. Es ging um Sichtbarkeit in ChatGPT, Perplexity und den AI Overviews von Google. Wir hatten uns gerade durch die Keywords und Queries gearbeitet — und dann kam die Frage: „Moment mal, ist eine Query nicht einfach das, was man in ChatGPT eintippt? Also ein Prompt?“

Kurze Pause. Und dann wurde klar: Diese beiden Begriffe werden überall synonym verwendet — in Blogs, auf LinkedIn, selbst in Tool-Oberflächen. Sie meinen aber nicht dasselbe. Wer das nicht sauber trennt, macht einen Error im Messdesign, der sich durch das gesamte Reporting zieht.

Dem Philosophen in mir ist an klarer Begriffsabgrenzung gelegen. Deswegen räumt dieser Artikel mit dem Begriffschaos auf. Du bekommst eine klare Abgrenzung zwischen Query und Prompt, ein einfaches mentales Modell und verstehst am Ende, warum diese Unterscheidung für alles, was du in Sachen SEO, GEO und AI-Sichtbarkeit tust, den Unterschied macht.

Inhalt dieser Seite

Die Query in der Such- und Softwarewelt

Der Begriff Query stammt ursprünglich nicht aus der AI-Welt. Er kommt aus der Welt der Datenbanken und Search Engines. Wenn ein Software Engineer eine SQL-Query an eine Datenbank stellt, fragt er strukturierte Information mit einer präzisen Syntax ab. Google ist im Kern nichts anderes: ein riesiges Retrieval-System, das auf deine Query ein Set an passenden Dokumenten zurückgibt — basierend auf Keywords, Embeddings und einem komplexen Ranking-System.

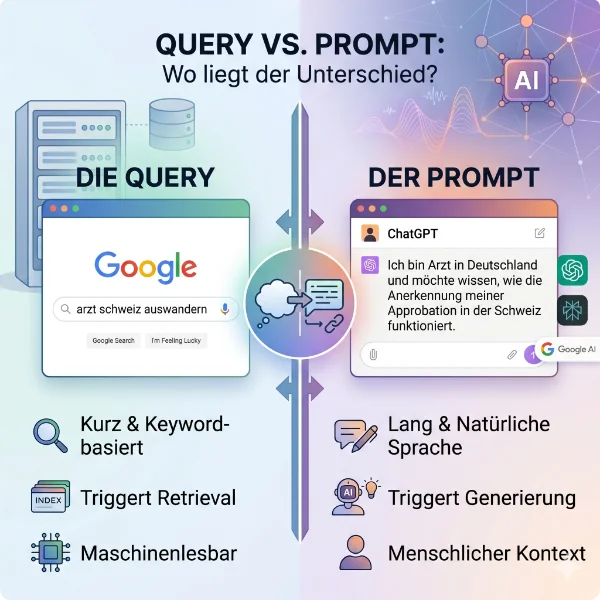

Eine Query in der Suche ist typischerweise:

- kurz, oft nur zwei bis fünf Wörter

- keyword-artig, ohne ausformulierte Grammatik

- auf ein schnelles Retrieval von Informationen ausgelegt

Beispiele: „arzt schweiz auswandern“, „beste seo agentur münchen“, „unterschied query prompt“.

Und hier kommt ein Punkt, den viele übersehen: Eine Query ist schon in der klassischen Suche nie nur eine Buchstabenfolge. Google interpretiert seit RankBrain und BERT semantisch — hinter jeder Query steht ein Intent, eine Suchintention. Der Keyword-Forscher bringt also immer schon Interpretation mit in seine Liste. Aus Keywords werden Intentionen. Das ist kein Bug, das ist das Handwerk.

200+

5,0

zufriedene Kunden

Was ist ein Prompt genau?

Ein Prompt ist etwas anderes. Der Begriff stammt aus der Welt der Large Language Models — also aus Systemen wie ChatGPT, Claude oder Gemini. Ein Prompt ist die Eingabe, mit der du einen LLM anweist, etwas zu tun: zu antworten, zu erklären, zu schreiben, zu vergleichen, zu analysieren.

Ein Prompt ist typischerweise:

- länger als eine Query, oft ein vollständiger Satz oder ganzer Absatz

- in natürlicher Sprache formuliert

- kontextreich, oft mit Rolle, Aufgabe und Stilvorgabe

- auf eine generative Response ausgelegt, nicht auf ein bloßes Retrieval

Ein Beispiel: „Ich bin Allgemeinmediziner in Deutschland und überlege, in ein anderes Land zu ziehen. Was muss ich bei der Anerkennung meiner Approbation beachten, und wie sieht es steuerlich aus?“

Das ist kein Keyword-String. Das ist ein Mini-Briefing.

Was braucht ein Prompt?

Ein guter Prompt enthält in der Regel:

Rolle oder Kontext:

Wer fragt, in welcher Situation, mit welchem Job im Hintergrund?

Aufgabe oder Instruction:

Was soll der LLM konkret tun?

Format oder Style:

Wie soll die Antwort aussehen? Fließtext, Liste, Vergleichstabelle?

Beispiele oder Daten:

Welche Info soll das Model berücksichtigen?

Das ist der Kern von Prompt Engineering — der Disziplin, Prompts so zu bauen, dass der LLM die gewünschten Answers in hoher Quality liefert. Die Art liegt darin, Mehrdeutigkeit zu reduzieren, ohne das Modell einzuengen. Ein Error im Prompt — eine unpräzise Instruction, ein fehlender Kontext — und die Response kippt. Prompt Engineering ist kein Hexenwerk, aber auch keine Trivialität.

System Prompt und User Prompt

Ein kleiner, aber wichtiger Unterschied: Wenn du in ChatGPT etwas eintippst, bist du der User — deine Eingabe ist ein User Prompt. Dahinter läuft aber meistens ein System Prompt, den du nicht siehst. Der System Prompt legt fest, wie sich der Assistant grundsätzlich verhält: welche Rolle er einnimmt, welche Regeln er befolgt, welchen Tonfall er verwendet.

Beispiel: Ein Kundenservice-Bot hat einen System Prompt wie „Du bist ein freundlicher Support-Assistant für Produkt X. Beantworte nur Fragen zu Produkt X.“ Der User Prompt ist dann die konkrete Kundenfrage, die darauf trifft. Die Response, die der User am Ende bekommt, entsteht immer aus dem Zusammenspiel beider — plus dem Wissen des Modells und gegebenenfalls externen Datasets. Das Stichwort dazu heißt Retrieval Augmented Generation, kurz RAG: Der LLM zieht bei seiner Generierung zusätzliche Informationen aus einer externen Datenbank heran, um die Accuracy und Relevance seiner Answers zu erhöhen. Diese Implementation ist heute Standard in ernstzunehmenden AI Tools.

Query und Prompt im direkten Vergleich

Hier die entscheidenden Differences zwischen Query und Prompt in einer Gegenüberstellung:

Dimension

Query

Prompt

Herkunft

Datenbank, Search Engine

LLM, generative AI

Form

kurz, keyword-artig

lang, natürliche Sprache

Ziel

Retrieval von Dokumenten

Generierung einer Antwort

Kontext

minimal

reichhaltig, oft mit Rolle und Instruktion

Beispiel

“artz auswandern”

“Was muss ich als deutscher Arzt beachten, wenn ich in einem anderen Land arbeiten möchte?”

Output

Link-Liste, Snippets

Fließtext, strukturierte Antwort

Der entscheidende Unterschied ist nicht die Länge. Es ist die Art der Verarbeitung: Eine Query triggert ein Retrieval aus einem Index. Ein Prompt triggert eine Generierung aus einem Sprachmodell, das tokenweise Output produziert — basierend auf Embeddings, Trainingsdaten und dem gegebenen Kontext.

Prompt oder Frage — wo liegt der Unterschied?

Auch diese Frage taucht oft auf. Eine Question ist eine Unterform des Prompts — nicht jeder Prompt ist eine Frage, aber jede Frage an einen LLM ist ein Prompt.

Beispiele, die keine Fragen sind, aber trotzdem Prompts:

- „Schreibe mir einen Blogartikel über Core Web Vitals.“

- „Fasse diesen Text in drei Sätzen zusammen.“

- „Übersetze das Folgende ins Englische.“

Das sind Instructions, keine Questions. Ein Prompt kann also eine Frage enthalten — muss aber nicht.

Frage und Query — die menschliche und die maschinelle Form

Die Query ist die komprimierte, maschinenlesbare Form dessen, was ein Mensch wissen will. Die Question ist die ausformulierte, menschliche Form derselben Absicht.

Eine Person, die bei Google „arzt auswandern“ tippt, würde einen Freund niemals so ansprechen. Zum Freund würde sie sagen: „Sag mal, was muss ich eigentlich machen, wenn ich als Arzt auswandern will?“ — das ist die Question. Die Query ist die verdichtete Übersetzung für die Search Engine.

Ein Prompt enthält eine Query — das mentale Modell

Hier kommt das Modell, das dir die Begriffe in Zukunft sauber sortiert:

Ein Prompt enthält immer eine Query. Im Kern jedes Prompts steckt eine Suchintention, die sich als Query ausdrücken lässt. Der LLM extrahiert diese Intention intern aus dem Prompt — ähnlich wie Google es bei einer Suche tut — und erzeugt daraus seine Response. Das ist die Basis, auf der AI-Antworten überhaupt funktionieren.

Eine Query kann mehrere Prompts abbilden. Die Query „arzt auswandern“ kann in hundert verschiedenen Prompts vorkommen: als einfache Frage, als ausführliches Briefing, als Vergleichsaufgabe. Jeder dieser Prompts zielt auf denselben Intent, erzeugt aber potenziell unterschiedliche Antworten und damit unterschiedliche Zitationsmuster in den LLM-Results.

An dieser Stelle lohnt ein Seitenblick in die Sprachphilosophie. Gottlob Frege hat Ende des 19. Jahrhunderts zwischen Sinn und Bedeutung unterschieden. Die Bedeutung ist der Gegenstand, auf den ein Ausdruck sich bezieht. Der Sinn ist die Art, wie dieser Gegenstand dabei präsentiert wird. Sein berühmtes Beispiel: Morgenstern und Abendstern haben dieselbe Bedeutung — den Planeten Venus — aber einen unterschiedlichen Sinn. Zwei Ausdrücke, zwei Begriffe, ein und dasselbe Ding.

Genauso verhält es sich mit Query und Prompt. Die Query „arzt auswandern“ und der Prompt „Was muss ich als Arzt beachten, wenn ich auswandern will?“ haben dieselbe Bedeutung — die Suchintention, etwas über das Auswandern von Ärzten zu erfahren. Sie haben aber unterschiedliche Sinne: unterschiedliche sprachliche Formen, unterschiedliche Wege, auf dasselbe zu referieren. Die Sprache bietet viele Pfade zum gleichen Gegenstand. Diese Einsicht ist älter als jede AI — aber sie trägt die ganze Messarchitektur moderner Sichtbarkeit. Wer Sichtbarkeit in AI Tools messen will, muss die Bedeutung (den Intent) von der sprachlichen Form (Query oder Prompt) unterscheiden können. Erst dann siehst du, ob ein Kunde dich findet — egal, welche Worte er dafür wählt.

Das ist keine semantische Spielerei. Es ist die Grundlage dafür, wie moderne Sichtbarkeit überhaupt gemessen werden kann — weil sich klassische Suche und LLM-Antworten in genau diesem Punkt überschneiden und gleichzeitig unterscheiden.

Warum der Unterschied für deine Sichtbarkeit entscheidend ist

Wer heute nur auf klassische Google-Queries und Keywords optimiert, verpasst ChatGPT, Perplexity und Co. Wer nur auf Prompts trackt, verpasst die AI Overviews von Google, die aus Queries getriggert werden. Beide Welten koexistieren — und beide brauchen eine eigene Mess- und Optimierungslogik.

In der Praxis heißt das: Dein SEO- und GEO-Tracking muss beides abbilden. Queries als strategische Intent-Anker, Prompts als tatsächliche Messinstrumente in den LLMs. Wenn das zusammenspielt, siehst du nicht nur, wonach Menschen suchen, sondern auch, wie sie dich tatsächlich fragen — und ob du in beiden Welten sichtbar bist. Das ist der Punkt, an dem GEO und SEO heute konvergieren.

Wie du so ein zweistufiges Tracking konkret aufbaust, welche Tools das leisten und wie das Reporting aussieht, haben wir im Folgeartikel ausführlich beschrieben: Queries tippst du. Prompts formulierst du. Und dein GEO-Tracking braucht beides. Dort findest du die vollständige Messarchitektur, inklusive Tool-Vergleich von RankScale, SE Ranking, Peec AI, Otterly und Vecdoor.

200+

5,0

zufriedene Kunden

Fazit: Warum der Unterschied zählt

Query vs Prompt ist kein akademischer Streit. Es ist die Trennlinie zwischen zwei Epochen der Informationssuche — und beide existieren parallel. Wenn du verstehst, dass ein Prompt eine Query enthält und eine Query mehrere Prompts abbilden kann, hast du das mentale Werkzeug, um GEO, SEO und AI-Sichtbarkeit souverän zu denken. Die sprachphilosophische Pointe dahinter: Der Gegenstand bleibt derselbe, die Form variiert. Genau das musst du in deinem Tracking abbilden.

Bei JSH Marketing — Die Google Doktoren — bauen wir genau auf diesem Fundament. Wir messen klassische Suche und LLM-Sichtbarkeit in einer integrierten Logik, weil du als Kunde beides brauchst. Wenn du wissen willst, wie deine Marke in ChatGPT, Perplexity, Claude und den AI Overviews von Google dasteht, sprich uns an.