Dein wichtigster Besucher hat kein Gesicht mehr

Während du diesen Artikel liest, besucht gerade ein KI-Agent eine Website. Er klickt nicht, scrollt nicht, sieht keine Bilder und kein Design. Er liest, verarbeitet, entscheidet – im Auftrag eines Menschen, der AI-Tools wie ChatGPT, Claude oder GitHub Copilot eine Frage gestellt hat. Diese Tools holen sich Informationen direkt von Webseiten, ohne Umweg über klassische Suchmaschinen.

Das ist das Agentic Web. Cloudflare hat am 17. April 2026 im Rahmen der Agents Week 2026 einen Scan von 200.000 meistbesuchten Domains veröffentlicht: Unter 4 % der Websites sind technisch darauf vorbereitet, mit AI-Agenten sauber zu kommunizieren. Wir haben unsere eigene Seite geprüft – ernüchternd. Genau das ist die Opportunity: Wer jetzt handelt, verschafft sich Vorsprung.

In diesem Artikel erklären wir, was das Agentic Web ist, wie der Cloudflare Agent Readiness Check funktioniert, welche Standards und Tools relevant sind – und wie sich klassische SEO in diesem Zeitalter weiterentwickelt. Dazu gibt es konkrete Tipps zur Umsetzung.

Inhalt dieser Seite

Was ist Agentic Web? Eine Definition

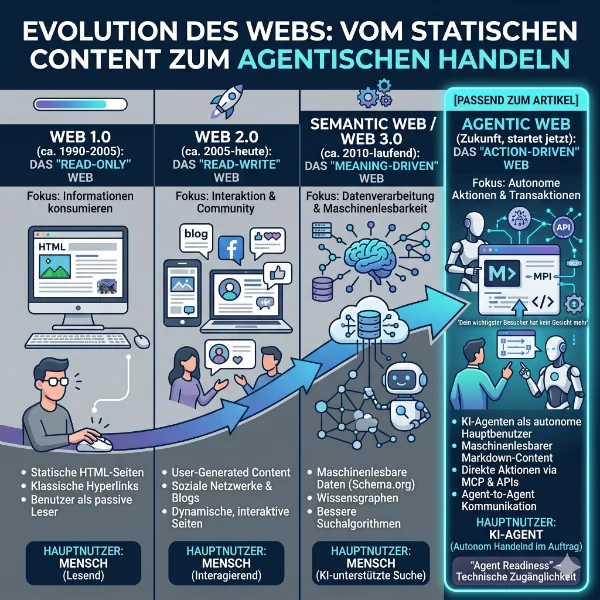

Das Agentic Web beschreibt eine neue Phase des Internets, in der autonome Software-Agenten die primären Nutzer von Websites werden. Statt eine URL in den Browser zu tippen, stellt ein Mensch einem KI-Modell eine Frage – und der Agent übernimmt Recherche, Preisvergleich, Buchung oder Transaktion eigenständig. AI-Agenten agieren selbstständig, ohne dass jeder Schritt vom Menschen vorgegeben werden muss. Die Grundlagen dafür liefern moderne KI-Modelle wie GPT, Claude oder Gemini in Kombination mit Tools, Schnittstellen und Agenten-Frameworks.

Die Kernidee: Im Agentic Web agieren AI-Agenten als Hauptbenutzer des Internets, die Interaktion zwischen Agenten wird zur neuen Norm. Statt klassischer Google-Suche nutzen Menschen zunehmend KI-Suche über ChatGPT, Perplexity oder die AI Overviews in Google. Das Web transformiert sich von einer konsumierten Plattform zu einer, die aktiv von AI-Agenten bearbeitet wird. Autonome KI-Modelle können repetitive oder komplexe Aufgaben schneller erledigen als Menschen – und tun es längst.

Agentic Web vs. Web 3.0: Was ist der Unterschied?

Oft wird das Agentic Web mit Web 3.0 verwechselt. Der Unterschied: Web 3.0 fokussiert sich auf Maschinenlesbarkeit von Daten und Dezentralisierung, während das Agentische Web darüber hinausgeht und autonom handelt. Es reicht nicht, dass Inhalte für Maschinen lesbar sind – die Maschinen treffen Entscheidungen und führen Aktionen selbstständig aus.

Was versteht man unter „agentic”?

Der Begriff agentic (deutsch: „agierend”, „handlungsfähig”) stammt aus der KI-Forschung und beschreibt AI-Systeme, die aktiv planen, entscheiden und Aktionen ausführen. Ein klassischer Chatbot antwortet auf eine Frage. Ein agentisches KI-System zerlegt die Frage in Teilaufgaben, ruft Tools auf, wertet Ergebnisse aus und liefert einen Output – oder führt direkt eine Aktion aus.

Bittest du einen AI-Agenten, dir eine Reise zu planen, bucht er Flug, Hotel und Mietwagen selbst, vergleicht Preise und liest Bewertungen. Im Agentischen Web übernehmen AI-Agenten die Recherche, den Preisvergleich und die Durchführung von Transaktionen. Auch Kundensupport und Verkaufsprozesse können von solchen Diensten selbstständig durchgeführt werden.

200+

5,0

zufriedene Kunden

Was ist ein agentischer Browser?

Ein agentischer Browser ist nicht mehr primär für menschliche Nutzer gebaut, sondern integriert Agenten als First-Class-Citizens. Produkte wie Perplexity Comet, ChatGPT Atlas oder Cursor gehen in diese Richtung: Der Agent konsumiert das Web, trifft Entscheidungen und führt Aufgaben aus, während der Mensch das Ergebnis abnickt. Inhalte werden in maschinenlesbarer Form verarbeitet – idealerweise als Markdown.

Die neuen Besucher: Welche AI-Agenten parsen deine Website?

Du kennst deine Besucher bisher aus Google Analytics oder Microsoft Clarity. Dahinter gibt es eine zweite Schicht: AI-Tools, die deine Inhalte konsumieren, bevor jemals ein Mensch landet. Die wichtigsten Tools und ihre Funktionen im Überblick:

- ChatGPT (OpenAI) – KI-Suche und Browsing, Deep Research, Zugriff auf Webseiten in Echtzeit

- Claude Code (Anthropic) – Code-Review und Entwickler-Recherche, Open Source MCP-Ecosystem

- GitHub Copilot (Microsoft) – in Millionen IDEs integriert, zentrale Tools für Entwickler

- Cursor – AI-First Code-Editor mit tiefem Web-Zugriff

- Perplexity – KI-Suchmaschine mit eigenen Crawlern und Agenten-Funktionen

- Google Gemini – mit wachsender Agent-Funktionalität in der Google-Suche und AI Overviews

Vor allem Microsoft GitHub Copilot hat den Alltag von Entwicklern verändert. Diese AI-Tools automatisieren Programmieraufgaben, steigern die Effizienz und gestalten den Lebenszyklus der Softwareentwicklung neu. Regelmäßige Updates erweitern die Funktionen kontinuierlich.

Was sind die 5 Typen von KI-Agenten?

Die KI-Forschung unterscheidet klassisch fünf Typen:

- Simple Reflex Agents – reagieren nach festen Regeln auf aktuelle Wahrnehmungen

- Model-Based Reflex Agents – halten ein internes Modell der Welt

- Goal-Based Agents – handeln zielgerichtet und planen Schritte

- Utility-Based Agents – bewerten Aktionen nach einem Nutzenmaß

- Learning Agents – passen ihr Verhalten durch Erfahrung kontinuierlich an

Aktuelle Produkte wie ChatGPT, Claude oder GitHub Copilot sind Mischformen – primär Learning Agents mit starken Goal- und Utility-Komponenten.

Was sind die 4 Säulen der KI-Agenten?

Die moderne Agenten-Architektur stützt sich auf vier Säulen:

1

2

3

4

Perception – Wahrnehmung der Umgebung (Web-Inhalte, APIs, Nutzereingaben)

Reasoning – logisches Schließen und Planen der nächsten Schritte

Action – Ausführung (API-Calls, Tool-Nutzung, Content-Erstellung)

Learning – Anpassung und Verbesserung über Zeit

Diese Kette bricht, wenn deine Website in Schritt 1 scheitert: Kann der Agent deine Inhalte nicht wahrnehmen, kommen Reasoning, Action und Learning gar nicht erst zum Tragen.

Warum das Agentic Web deine Arbeit und dein Geschäft verändert

Das Agentische Web ermöglicht die Kommunikation zwischen Software-Agenten, um komplexe Ziele zu erreichen. Agenten planen und koordinieren Aufgaben eigenständig, reagieren dynamisch auf Bedrohungen und ergreifen in Echtzeit Abwehrmaßnahmen. Sie kümmern sich um automatisierte Recherche, Buchungen, Kundensupport und Cybersicherheit.

Für den E-Commerce besonders radikal: Agenten übernehmen die gesamte Transaktion inklusive Produktrecherche und Preisverhandlung. Sie greifen auf Products-Feeds zu, vergleichen Websites und führen Checkout-Prozesse aus. Durch spezialisierte Agenten-Stacks erhalten auch kleine Teams Zugang zu komplexen Analyse- und Planungsfunktionen.

Token-Ökonomie: Warum Markdown plötzlich wichtiger ist als HTML

Jedes KI-System arbeitet mit einem begrenzten Kontextfenster. Jeder Token kostet Rechenzeit, Geld und Genauigkeit. Wenn deine Website HTML-lastig und JavaScript-getrieben ist, frisst ein einziger Fetch dem Agenten einen erheblichen Teil seines Kontexts weg. Cloudflare hat bei der Umstellung auf Markdown-Auslieferung eine Token-Reduktion von bis zu 80 % pro Seite gemessen.

Aktuelle KI-Systeme parsen rohen HTML-Code und analysieren visuelle Elemente, was problematisch wird, wenn sich das Layout ändert oder dynamische Inhalte nachgeladen werden. Strukturierte Daten, klare Sitemaps und maschinenlesbare Inhalte werden damit zum Kern-Ranking-Faktor – nicht mehr nur für Suchmaschinen, sondern für die neuen AI-Agenten.

Was ist Agent Readiness?

Agent Readiness (deutsch: „Agentenbereitschaft”) ist ein Maß dafür, wie gut eine Website oder ein Codebase autonome AI-Agenten unterstützt – durch klare Konventionen, solide Test-Suiten und gute Dokumentation. Cloudflare hat den Begriff mit dem Agent Readiness Score in ein konkretes, messbares Framework gegossen – vergleichbar mit Google Lighthouse für Performance. Der Name des Tools bringt die Funktion auf den Punkt.

Die Logik: Scores mit actionable Feedback haben schon in der Vergangenheit die Adoption neuer Web-Standards beschleunigt. Google Lighthouse hat die Performance-Optimierung mainstreamfähig gemacht. Der Agent Readiness Score soll dasselbe für das Agentic Web leisten – mit klaren Anforderungen, messbaren Werten und passenden Tools zur Umsetzung.

Der Cloudflare Agent Readiness Check im Detail

Der Check prüft deine Website nach vier Dimensionen. Eine fünfte Dimension – Commerce – wird geprüft, aber aktuell nicht in den Score eingerechnet. Für jeden nicht bestandenen Check liefert das Tool einen Copy-Paste-Prompt für AI-Tools wie Claude Code, Cursor oder GitHub Copilot. Entwickler können diese Prompts direkt weiterverwenden.

1. Discoverability: Kann der Agent deine Inhalte überhaupt finden?

Geprüft werden hier die Basics plus eine wichtige Neuerung:

- robots.txt – vorhanden, erreichbar, mit expliziten Regeln für AI-Bots

- sitemap.xml – vollständig, korrekt verlinkt, aktuell

- HTTP Link Headers (RFC 8288) – Verweise auf API-Kataloge und wichtige Ressourcen direkt im HTTP-Response-Header

Der Link-Header ist ein echter Gamechanger: Agenten müssen nicht mehr tonnenweise HTML parsen, sondern lesen wichtige Ressourcen direkt aus dem Response-Header.

2. Content: Lieferst du saubere, agent-freundliche Inhalte?

Geprüft wird, ob deine Website Markdown Content Negotiation unterstützt. Sendet ein Agent den Header Accept: text/markdown, sollte dein Server eine saubere Markdown-Version statt HTML ausliefern. Das reduziert den Token-Verbrauch drastisch und erhöht die Chance, dass dein Content vollständig verarbeitet wird.

Ergänzend wird llms.txt geprüft – eine Textdatei im Root-Verzeichnis, die Agenten einen strukturierten Überblick über deine wichtigsten Inhalte gibt. Eine Sitemap für LLMs: kurze Einleitung, Linkliste mit den wichtigsten Dokumenten als .md-Versionen.

3. Bot Access Control: Regelst du sauber, wer was darf?

Diese Kategorie prüft drei Standards:

- AI-Bot-Regeln in robots.txt – explizite Directives für GPTBot, ClaudeBot, Google-Extended, PerplexityBot

- Content Signals – neuer Standard für granulare Steuerung: ai-train (Training erlaubt?), ai-input (Kontext/Grounding?), search (klassische Suche?)

- Web Bot Auth – IETF-Entwurf, mit dem Bots ihre Requests signieren und Websites diese gegen Public Keys verifizieren

Stand heute haben nur rund 4 % aller Websites Content Signals implementiert – die Adoption-Kurve steht ganz am Anfang.

4. Capabilities: Kann der Agent mit deiner Seite interagieren?

Die spannendste Kategorie, weil sie den Sprung von „Content lesen” zu „Aktionen ausführen” markiert:

- Agent Skills Index unter /.well-known/agent-skills/index.json – Liste der Skills, die dein Service Agenten anbietet

- API Catalog (RFC 9727) unter /.well-known/api-catalog – zentrales Verzeichnis deiner APIs mit Links zu Specs und Docs

- MCP Server Card – JSON-Datei, die einen Model Context Protocol Server beschreibt, bevor ein Agent sich verbindet

- WebMCP – Browser-API für direkte Agent-Interaktion ohne Backend-Integration

- OAuth Server Discovery (RFC 9728) – damit Agenten sich sauber authentifizieren können

Das Model Context Protocol (MCP) ist hier das zentrale Stichwort. MCP und sein Browser-Pendant WebMCP ermöglichen es Websites, strukturierte, aufrufbare Werkzeuge direkt für KI-Agenten bereitzustellen – ohne externe API-Keys oder Backend-Integrationen. Statt visuelle Elemente zu interpretieren, bekommen Agenten eine saubere Schnittstelle und greifen effizient auf Datenquellen und APIs zu.

Der Status Quo: Das offene Internet ist erschreckend unvorbereitet

Cloudflare Radar hat die 200.000 meistbesuchten Domains gescannt und daraus den Datensatz „Adoption of AI agent standards” gebaut. Die wichtigsten Zahlen:

- robots.txt vorhanden: 78 % – fast universell, aber überwiegend nur für klassische Suchmaschinen-Crawler geschrieben

- Content Signals in robots.txt: 4 % – neuer Standard mit wachsendem Momentum, aber noch am Anfang

- Markdown Content Negotiation: 3,9 % – nur jede 25. Website liefert saubere Markdown-Versionen aus

- MCP Server Cards + API Catalogs: zusammen weniger als 15 Seiten im gesamten Datensatz

Eine Messung von Checkly (Februar 2026) zeigt: Von 7 getesteten Agenten fragen nur Claude Code, OpenCode und Cursor standardmäßig mit Accept: text/markdown an. Andere – darunter ChatGPT und viele GitHub-Copilot-Integrationen – holen sich weiterhin HTML. Fallback-Strategien wie /index.md-URLs sind also Pflicht.

Die Chance: Wer jetzt technisch sauber aufstellt, sitzt in einer Phase massiver Adoption auf der richtigen Seite der Kurve. Wir erwarten in den kommenden Monaten regelmäßige Updates zu diesen Standards – und Websites, die jetzt handeln, profitieren von der Entwicklung.

Wie kann ich meine Website für KI optimieren?

Konkret loslegen – vom einfachen Quick-Win bis zur tieferen Infrastruktur-Arbeit:

- robots.txt überarbeiten – AI-Bots explizit ansprechen, Content Signals ergänzen, Sitemap-URL prüfen

- llms.txt anlegen – im Root deiner Website, mit kuratierter Linkliste der wichtigsten Inhalte als Markdown-Versionen

- Markdown Content Negotiation aktivieren – bei Accept: text/markdown eine saubere .md-Version ausliefern

- Strukturierte Daten ausbauen – Schema.org, Author-Schema, FAQ-Schema, Produkt-Schema

- HTTP Link Headers ergänzen – API-Catalog, Alternates, wichtige Ressourcen direkt im Response-Header

- Entity-Klarheit schaffen – konsistente Marken-, Personen- und Produktnennungen, klarer Name der Entität, Wikidata-Präsenz

- Agent Readiness Check laufen lassen – das Ergebnis nutzen, um den Backlog zu priorisieren

Das sind Best Practices und Anleitungen, die du oder ein technisch affines SEO-Team in wenigen Wochen umsetzen kannst. Viele Anforderungen überschneiden sich mitklassischer technischer SEO. Neu sind vor allem llms.txt, Markdown-Auslieferung und MCP-Integration. Diese Tools und Standards bilden das neue Fundament.

Wie kann KI eine Website optimieren?

Andersherum wird auch ein Schuh draus: Agenten sind nicht nur Besucher, sondern auch Tools. Der Agent Readiness Check liefert Prompts, die du direkt an Claude Code oder GitHub Copilot übergibst, damit die Agenten die Fixes selbstständig umsetzen. Statt fünf Entwickler-Tage brauchst du einen guten Prompt und ein Review.

Wie optimiert man eine Website für ChatGPT?

Für ChatGPT-Sichtbarkeit (klassische Antwort und ChatGPT Search) zählen:

- GPTBot erlauben in robots.txt (oder bewusst ausschließen, aber nie versehentlich blockieren)

- Klare Entity-Signale – Author Schema, About-Seite, Expertise-Nachweise

- Strukturierte, thematisch geschlossene Artikel – echte Antworten auf echte Fragen

- Zitierbarkeit – klare Aussagen, belastbare Zahlen, nachvollziehbare Quellen

- Markdown-Fallback via /index.md – sonst liest ChatGPT ein schwergewichtiges HTML-Dokument

KI-Suchmaschinen analysieren Inhalte und erfassen Bedeutungen und Zusammenhänge, um präzise Antworten auf Fragen der Benutzer zu liefern. Dabei nutzen sie zunehmend natürliche Sprache als Eingabe. Die Optimierung für AI-Agenten erfordert eine klare Struktur, gute Webseiten und eine übersichtliche Darstellung der Inhalte.

Wie bringe ich KI dazu, meine Website zu empfehlen?

Die ehrliche Antwort: erzwingen geht nicht – aber die Wahrscheinlichkeit lässt sich massiv erhöhen. Drei Hebel funktionieren heute zuverlässig:

Entity-Authority – sei zu einem Thema die klar erkennbare Quelle. Wiederholte Nennung deines Namens und deiner Marke in Kombination mit den richtigen Keywords über mehrere Quellen hinweg.

Qualität der Antworten – KI-Modelle priorisieren strukturierte, präzise und zitierbare Inhalte. Klare H2-Strukturen, belegte Aussagen.

Technische Zugänglichkeit – llms.txt, Markdown, saubere Sitemap, Schema Markup. Was der Agent nicht effizient lesen kann, empfiehlt er auch nicht.

Das ist die Agent Engine Optimization (AEO), die klassisches SEO ergänzt. AEO beschreibt die Praxis, digitale Angebote so aufzubereiten, dass AI-Agenten sie effizient nutzen können. Wer sich in diesem Zeitalter positionieren will, arbeitet an allen drei Ebenen gleichzeitig.

Mehr dazu auf unserer GEO-Leistungsseite, wo wir zeigen, wie wir Sichtbarkeit in KI-Suchmaschinen wie ChatGPT, Perplexity und Google AI Overviews konkret aufbauen.

SEO ist nicht tot – SEO entwickelt sich weiter

Klares Statement: Nein, SEO ist nicht tot. SEO entwickelt sich weiter. Das „SEO ist tot“-Narrativ macht seit zwei Jahrzehnten die Runde – bei jeder neuen Technologie (mobile, Voice, AI Overviews). Und lag jedes Mal falsch.

Was sich ändert, ist die Ausspielung. Was bleibt, ist die Disziplin: technische Exzellenz, Content-Qualität, Entity-Klarheit, Nutzerorientierung. Wir sehen drei Ebenen derselben Disziplin, die parallel wachsen:

- Klassisches SEO – Sichtbarkeit in der blauen Linkliste bei Google und Bing, mit Fokus auf die richtigen Keywords

- GEO (Generative Engine Optimization) – Sichtbarkeit in den Antworten generativer KI-Suchmaschinen

- Agent Readiness / AEO – technische Zugänglichkeit für autonome AI-Agenten

Jede Ebene baut auf der vorherigen auf. Wer bei der technischen Grundlage schlampt, verliert auf allen drei Ebenen. Das Ziel bleibt gleich – die richtige Antwort zur richtigen Zeit für den richtigen Nutzer. Die Weise erweitert sich. Die Keywords werden breiter: Neben klassischen Suchbegriffen zählen jetzt auch natürliche Fragen, strukturierte Antworten und maschinenlesbare Standards.

Cloudflare, Microsoft & Co: Die neue Infrastruktur des Agentic Web

Die Tools und Standards entstehen in beispielloser Geschwindigkeit. Die wichtigsten Spieler und Neuigkeiten im Überblick:

- Cloudflare – Agent Readiness Score, Markdown for Agents, Content Signals, x402 Payment Protocol, Agent Cloud Expansion

- Microsoft – GitHub Copilot als einer der meistgenutzten AI-Tools weltweit, Azure als Infrastruktur für agentische Softwareentwicklung und Entwicklung von AI-Diensten

- Anthropic – Model Context Protocol (MCP) als offener Open-Source-Standard, Claude Code als produktiver Coding-Agent

- GitHub – GitHub Copilot, GitHub Actions for Agents, viele offizielle Open-Source-Repositories zu MCP, Agent Skills und llms.txt

- Google – AI Overviews, Gemini als Agent, Content-Signals-Unterstützung in Google-Extended

- OpenAI – ChatGPT mit Browsing und Deep Research, GPTBot als einer der aktivsten Crawler

Das Agentic Web ist kein Hype eines einzelnen Anbieters, sondern die gemeinsame Richtung der gesamten Branche – mit Open-Source-Standards, offiziellen RFCs und breiter Adoption.

So arbeiten wir bei JSH mit dem Agentic Web

Unser Ausgangspunkt: Sapere Aude – habe Mut, dich deines eigenen Verstandes zu bedienen. Auf das Agentic Web übersetzt: nicht blind jedem KI-Trend hinterherrennen, sondern prüfen, was trägt. Diagnose vor Therapie.

Konkret:

- Agent Readiness Audit als neuer Bestandteil jedes technischen SEO-Checks

- llms.txt, Markdown-Fallbacks und Content Signals in der technischen Basis jeder Website

- Schema Markup und Entity Grounding für Google, ChatGPT, Claude, Perplexity und Gemini

- Monitoring agentischer Zugriffe als neue KPI-Disziplin parallel zum klassischen Traffic

- GEO-Strategie für Kunden, die aktiv Sichtbarkeit in KI-Antworten aufbauen wollen

Wir haben unseren eigenen Agent Readiness Score auf isitagentready.com geprüft – ernüchternd. Wie bei 96 % der Top 200.000. Wir arbeiten diese Punkte in den nächsten Wochen ab und machen die Schritte als Lernmaterial verfügbar. Offen, nachvollziehbar, diagnostisch.

Prüfe deinen eigenen Score unter isitagentready.com. Wenn du Hilfe bei der Umsetzung brauchst, sprich uns an.

Fazit: Die Weiterentwicklung fordert Mut – und eine klare Diagnose

Das Agentic Web ist kein Marketing-Schlagwort, sondern eine strukturelle Transition. AI-Agenten werden einen wachsenden Anteil des Traffics ausmachen. Websites, die jetzt technisch sauber aufstellen, werden gefunden, gelesen und empfohlen. Websites, die das nicht tun, werden übergangen – stillschweigend.

Agent Readiness ist kein Hexenwerk. Es ist eine erweiterte Form technischer SEO, mit ein paar neuen Standards (llms.txt, Markdown Content Negotiation, MCP) und einem klaren Messinstrument (Cloudflare Agent Readiness Score). Die Adoption-Kurve ist gerade erst gestartet – das macht jetzt den Unterschied zwischen Vorreiter und Nachzügler.

Unser Rat: diagnostizieren, priorisieren, umsetzen. Sapere Aude.

200+

5,0

zufriedene Kunden

FAQ: Häufige Fragen zum Agentic Web

Das Agentic Web ist die Phase des Internets, in der autonome KI-Agenten die primären Nutzer von Websites werden und im Auftrag von Menschen Aufgaben, Recherchen und Transaktionen eigenständig ausführen.

Nein. Web 3.0 fokussiert sich auf Maschinenlesbarkeit und Dezentralisierung. Das Agentic Web geht darüber hinaus – hier handeln autonome Systeme eigenständig, nicht nur Daten werden maschinenlesbar.

Der Check unter isitagentready.com ist kostenlos, vergleichbar mit Google Lighthouse für Performance.

Eine reine Textdatei im Root-Verzeichnis deiner Website (/llms.txt), die KI-Agenten einen strukturierten Überblick über deine wichtigsten Inhalte gibt – eine Art Sitemap, aber speziell für Large Language Models geschrieben.

Nur, wenn du Agenten aktive Funktionen bereitstellen willst (z. B. Suche, Buchung, API-Zugriff). Für reine Content-Websites reichen Discoverability und Content Accessibility. Für SaaS, E-Commerce oder Tool-Anbieter wird MCP in den nächsten 12 Monaten zum Standard.