Ein Geständnis vorab

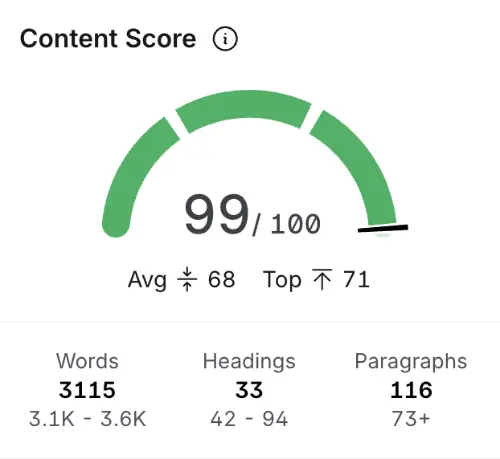

Ich gestehe direkt zu Beginn etwas, was eine Agentur normalerweise nicht öffentlich macht: Unsere eigene Landingpage für SEO Agentur München hatte vor einigen Monaten einen Surfer-Content-Score von 99 von 100. Inhaltlich vollständig nach Tool-Logik. Jede empfohlene Entität drin. Header-Struktur, Wortzahl, Subthemen — alles im grünen Bereich.

Geranked hat die Seite auf Position 14. Manchmal 15. Über Monate. Ohne nennenswerte Bewegung nach oben, ohne erkennbaren Trend. Mit jeder weiteren Surfer-Optimierung stieg der Score, das Ranking blieb gleich. Die Seite war gleichzeitig perfekt optimiert nach Tool-Logik und komplett festgenagelt jenseits der Top 10.

Das ist der Moment, in dem die meisten Agenturen entweder noch mehr optimieren oder anfangen, technische Ursachen zu suchen. Die ehrliche Diagnose war eine andere: Wir hatten unsere eigene Seite präzise in die Falle hineinoptimiert, vor der Google selbst inzwischen explizit warnt. Ich nenne sie die Commodity-Falle, und ich erkläre in diesem Artikel, was sie ist, warum sie ausgerechnet bei methodisch sauberer Arbeit zuschnappt, und wie wir Wettbewerbsanalyse seitdem anders denken.

Das hier ist kein Tool-Bashing. Wir nutzen Surfer weiterhin. Das Problem war nicht das Tool, sondern wie wir es eingesetzt haben — und genau diese Differenzierung ist der Kern dessen, was sich gerade verändert.

Inhalt dieser Seite

Was die Commodity-Falle ist

Der Begriff Commodity Content stammt aus Googles eigenem Vokabular. Im im Mai 2026 veröffentlichten AI-Optimization-Guide unterscheidet Google explizit zwischen commodity und non-commodity content. Commodity ist alles, was austauschbar ist: „7 Tipps für Erstkäufer”, „Was ist ein Backlink”, „Vor- und Nachteile von SEO”. Inhalte, die im Prinzip jeder schreiben könnte und die deshalb auch tausendfach existieren. Non-commodity ist das Gegenteil: eigene Daten, eigene Erfahrung, eine Position, die nur eine konkrete Person oder Firma einnehmen kann.

Die Falle ist nicht der Commodity Content selbst. Die Falle ist der Mechanismus, der Agenturen systematisch dort hin treibt — und zwar genau dann, wenn sie methodisch sauber arbeiten. Der Ablauf ist verblüffend einfach:

Du nimmst dir ein Keyword vor. Du schaust die Top 10. Du benutzt Surfer, Frase, NeuronWriter oder ein vergleichbares Tool, das aus der SERP einen Median bildet: durchschnittliche Wortzahl, gebräuchliche Headings, häufige Entitäten, typische Subthemen. Du baust deine Seite nach diesem Median — vielleicht ein Stück besser, ein Stück vollständiger. Das Tool sagt 92, 95, 99 Punkte. Du bist zufrieden.

Das Problem: Alle anderen Agenturen tun genau dasselbe. Ihre Tools rechnen mit denselben Daten. Das Ergebnis ist eine SERP, in der die Top 10 sich strukturell und inhaltlich immer ähnlicher werden — weil alle den Median nachbauen. Genau das ist Commodity per Definition. Und genau das hatte unsere München-Seite: einen perfekten Median-Score und keine einzige Position, an der sie sich von den anderen Münchner SEO-Agenturen unterschied.

200+

5,0

zufriedene Kunden

Warum der Median heute zum Nachteil wird

Im klassischen SEO war das egal. Wer den Median ein bisschen besser bediente, rankte. Im AI-Zeitalter dreht sich der Hebel um, und zwar aus zwei Gründen, die Google im Guide selbst ausführt.

Erstens: Retrieval-Augmented Generation (RAG). Wenn Google für AI Overviews und AI Mode Quellen sammelt, holt das System Inhalte aus dem Index, die unterschiedliche Informationen beisteuern. Zehn Seiten mit demselben Median sind für ein RAG-System redundant — neun davon werden ignoriert, weil sie nichts hinzufügen. Wer den Median perfekt trifft, wird in der AI-Antwort tendenziell unsichtbar, nicht sichtbarer. Das ist auch der Grund, warum Zero-Click-Search-Anteile in den letzten zwei Jahren so stark gestiegen sind: Wenn die AI-Antwort vollständig ist, klickt niemand mehr — und wenn dein Inhalt die AI-Antwort nicht mitformuliert, existierst du in diesem Suchsegment nicht..

Zweitens: Query Fan-Out. Das ist der zweite Mechanismus, den Google im neuen Guide beschreibt. Aus einer einzigen Nutzerfrage werden im Hintergrund mehrere Subqueries erzeugt, und für jede sucht das System eigene Quellen. Nimm „SEO Agentur München” als Beispiel. Was Google im Hintergrund tatsächlich abfragt, könnte so aussehen:

- Was kostet eine SEO-Agentur in München?

- Welche SEO-Agentur ist die beste in München?

- Lohnt sich eine lokale SEO-Agentur überhaupt?

- SEO-Agentur München für Handwerker / für Ärzte / für Kanzleien

- SEO-Agentur München Erfahrungen

- Unterschied SEO-Agentur und Webdesigner

- Wie erkenne ich eine seriöse SEO-Agentur

Wer für die Hauptfrage „SEO Agentur München” den perfekten Surfer-Median liefert, hat damit noch keine dieser Subqueries beantwortet. Eine perfekt mediankonforme Seite ist gegen Query Fan-Out wehrlos, weil sie zwar auf das Hauptkeyword zugeschnitten ist, aber an keiner Stelle ein konkretes Bedürfnis aus dem Fan-Out aufgreift. Die saubere Unterscheidung zwischen Query und Prompt — also zwischen dem, was der Nutzer eingibt, und dem, was die KI im Hintergrund daraus formuliert — ist deshalb der eigentliche Ausgangspunkt jeder modernen Keyword-Recherche.

Das ist der Mechanismus, der unsere München-Seite eingefangen hatte. Score 99 auf der Hauptquery — null Antworten auf das, was die KI im Hintergrund tatsächlich gefragt hat.

Warum die Konstanz das eigentliche Warnsignal war

In den Wochen und Monaten nach der Surfer-Optimierung war ich zunächst geduldig. Ich kenne den SEO-Markt, ich weiß, dass Rankings Zeit brauchen. Eine stabile Position 14 oder 15 ist nicht schlecht — es ist eine reale Sichtbarkeit, sie generiert Impressionen, sie ist nahe an der Top 10. Mein Gedanke war: gleich wird sie kippen, wir sind nur noch eine kleine Optimierung entfernt.

Was ich erst spät begriffen habe: Diese Konstanz war kein Plateau vor dem Aufstieg, sondern das exakte Ergebnis der Optimierung. Eine Seite, die den Median perfekt bedient, ist für Google ausreichend gut, um in der erweiterten Sichtbarkeitsmenge zu landen — also auf den Positionen 11 bis 20 — und gleichzeitig nicht differenziert genug, um eine der zehn Quellen zu sein, die Google für eine RAG-Antwort oder eine prominent platzierte Position auswählt. Position 14 war keine Übergangsstation. Sie war der natürliche Endpunkt der gewählten Methode.

Mit jeder weiteren Surfer-Iteration wurde der Score höher, das Ranking blieb gleich, und im Hintergrund verfestigte sich die Median-Position. Das ist die Falle in Reinform: Der Optimierungsmechanismus belohnt dich für jeden Schritt, den du machst, und führt dich gleichzeitig immer tiefer in eine Position, aus der du nicht mehr herauskommst, ohne den Mechanismus zu verlassen.

Die Wende kam nicht durch ein neues Tool oder eine technische Korrektur. Sie kam durch eine andere Frage. Statt zu fragen „Was fehlt mir gegenüber dem Median?” haben wir angefangen zu fragen: „Welche der Fan-Out-Subqueries beantwortet auf der gesamten SERP eigentlich niemand?” Und: „Wo habe ich aus zehn Jahren Münchner SEO-Praxis Material, das niemand sonst hat?” Das sind andere Fragen. Sie führen zu anderen Antworten. Und sie führen aus der Falle heraus.

200+

5,0

zufriedene Kunden

Bezug zu meinem früheren Artikel

In unserem Artikel SEO Konkurrenzanalyse: Wer ist dein Wettbewerb bei Google? habe ich eine andere These vertreten. Die Kernaussage dort: Wer seine SEO-Konkurrenten nicht systematisch über Sistrix, Ahrefs und SE Ranking identifiziert, optimiert ins Leere — weil Markt-Konkurrenten und SEO-Konkurrenten oft auseinanderfallen.

Diese These ist nicht falsch. Sie ist nur unvollständig. Sie beantwortet die Frage „Wen analysiere ich?” — und das ist die richtige erste Frage. Aber sie beantwortet nicht die zweite, viel wichtigere: „Wozu analysiere ich überhaupt?”

Wenn die Antwort auf die zweite Frage lautet „um nachzubauen, was bei den Top-Rankern funktioniert”, dann ist die methodisch saubere Identifikation der richtigen Konkurrenten ein Beschleuniger in die Commodity-Falle. Du baust dann eben präziser das nach, was alle anderen auch nachbauen. Der frühere Artikel braucht also eine zweite Hälfte — und die liefere ich hier. Wer die echten Konkurrenten identifiziert, hat den ersten Schritt richtig gemacht. Was er aus dieser Identifikation ableitet, entscheidet darüber, ob er rankt oder in der Falle landet.

Der Ausweg: Wettbewerbsanalyse als Gap-Diagnose

Wettbewerbsanalyse ist nicht obsolet geworden. Im Gegenteil — sie ist wichtiger denn je, aber für einen anderen Zweck. Nicht als Template-Quelle, sondern als Gap-Diagnose. Drei Arten von Gaps liefert eine saubere Analyse, und sie haben sehr unterschiedlichen strategischen Wert.

Gap 1 — Vollständigkeits-Defizit bei dir selbst

Themen, Entitäten oder Subthemen, die alle Top-Ranker behandeln und du nicht. Das ist defensive Hygiene. Du gleichst auf den Mindeststandard an. Wichtig, weil Google bei RAG Vollständigkeit als Signal nimmt: Wenn alle Top-Ergebnisse die Entität „Local Pack” behandeln und deine Seite zu „SEO Agentur München” das Thema komplett auslässt, fehlt dir ein thematischer Baustein, der dich aus dem RAG-Kontext rausnimmt.

Ein konkretes Beispiel aus unserer Analyse: Acht von zehn Top-Rankern für „SEO Agentur München” behandelten den Themenkomplex Google Business Profile / Local Pack explizit als eigenen Abschnitt. Unsere Seite hatte den Punkt nur am Rande gestreift. Das war ein Gap-1-Fund, den wir innerhalb eines Nachmittags geschlossen haben.

Strategisch ist Gap 1 aber nur Aufholen. Du wirst dadurch nicht sichtbarer als die anderen, du wirst nur nicht schlechter. Wer in diesem Modus stehenbleibt, landet zurück in der Commodity-Falle, nur eben präziser.

Gap 2 — Marktweite Lücken

Themen, Fragen oder Perspektiven, die im Themenfeld eine Rolle spielen, aber kein einziger der Top-Ranker behandelt. Das ist der eigentliche Hebel. Hier baust du etwas, das Google an keiner anderen Stelle in seinem Index findet — und genau solche Quellen zieht RAG bevorzugt in AI Overviews rein.

Marktweite Lücken erkennst du nicht aus Tool-Listen. Du erkennst sie, indem du selbst denkst, mit echten Kunden sprichst, und die Frage hinter der Frage identifizierst. Zwei Beispiele aus unserer eigenen Re-Analyse:

Keine der zehn Top-Agentur-Seiten für „SEO Agentur München” beantwortete ehrlich die Frage, woran ein Kunde erkennen kann, dass eine Agentur ihn gerade in die Commodity-Falle hineinoptimiert. Alle redeten über Methoden, Erfolge, Awards — niemand über die Risiken der eingesetzten Methodik. Das ist eine marktweite Lücke. Wer sie schließt, sagt etwas, was an keiner anderen Stelle der SERP existiert — und genau diese Sorte Absatz wird in AI-Antworten bevorzugt als Eintrittspunkt zitiert, weil sie eine Position einnimmt, die im Median schlicht nicht vorkommt.

Eine zweite Lücke war die Frage „Lohnt sich eine SEO-Agentur überhaupt — oder reicht eine gute interne Person?”. Keine der Münchner Agenturen war bereit, diese Frage ehrlich zu beantworten, weil sie das eigene Geschäftsmodell in Frage stellt. Wer sie ehrlich beantwortet (mit klarer Indikation: ab welcher Unternehmensgröße, bei welchem Wettbewerbsdruck, in welchen Branchen), nimmt eine Position ein, die in der gesamten SERP fehlt.

Gap 3 — Tiefen-Defizite bei allen

Themen, die alle Top-Ranker haben, aber oberflächlich behandeln. Das klassische Beispiel aus unserem eigenen Feld: „Was kostet SEO” haben alle Agenturen, aber 90 Prozent schreiben Plattitüden („kommt drauf an”). Unser Artikel Was kostet SEO? mit konkreten Preisstaffeln und GEO-Aufschlag ist genau ein solcher Tiefen-Gap-Move. Methodisch: Du nimmst ein Thema, das im Median schwach behandelt wird, und gehst datenbasiert und ehrlich in die Tiefe.

Für die München-Seite ist Gap 3 das Thema „Wie lange dauert SEO bis zu den ersten Ergebnissen”. Alle Agenturen sagen vage „3 bis 12 Monate”. Wer aus 145 Retainer-Projekten konkrete Zeitachsen pro Branche und pro Wettbewerbsdruck herausziehen kann, hat eine Information, die in dieser Spezifik niemand sonst auf der SERP hat.

200+

5,0

zufriedene Kunden

Wie ein Audit nach diesem Modell aussieht

Ein Wettbewerbsaudit sollte nicht mehr als simple Vergleichstabelle der Top 10 enden. Bei uns hat sich daraus ein Drei-Spalten-Modell entwickelt, das wir mittlerweile bei jedem Retainer-Onboarding einsetzen.

Schritt 1 — Konkurrenten identifizieren: Über Sistrix, Ahrefs oder SE Ranking die tatsächlich für dein Hauptkeyword rankenden Domains finden. Das ist die Stelle, an der mein früherer Artikel zur Konkurrenzanalyse weiterhin gilt.

Schritt 2 — Fan-Out manuell rekonstruieren: AI Mode, Perplexity und ChatGPT mit deiner Hauptquery befragen. Welche Subqueries spielen sich im Hintergrund ab? Welche Folgefragen stellt die KI selbst? Das sind die Inhalte, die deine Seite mitbeantworten muss.

Schritt 3 — Die drei Spalten füllen:

- Spalte 1 — Mein Vollständigkeits-Defizit: Welche Themen/Entitäten haben mindestens fünf der Top 10, ich aber nicht? → niedrige Priorität, schnell aufzuarbeiten, Hygiene.

- Spalte 2 — Marktweite Lücken: Welche Fan-Out-Fragen werden von keinem Top-Ranker beantwortet? Welche Perspektive vermeiden alle? → höchste strategische Priorität, Briefing-Material für völlig neuen Content.

- Spalte 3 — Schwach behandelte Themen: Welche Themen sind bei allen oberflächlich? Wo habe ich eigene Daten, eigene Erfahrung, eigene Position? → mittlere Priorität, Briefing-Material für Tiefen-Überarbeitung bestehender Inhalte.

Spalte 1 ist das, was Tools wie Surfer gut können. Spalte 2 und 3 entstehen nur durch redaktionelle Arbeit, durch Kundengespräche, durch eigene Erfahrung. Genau hier liegt der Wert einer Agentur, die nicht nur Tool-Operator ist.

Wann Surfer trotzdem unverzichtbar bleibt

Es wäre intellektuell unredlich, aus diesem Artikel ein Anti-Tool-Manifest zu machen. Surfer und vergleichbare Content-Tools haben eine klare Rolle — und sie ist wertvoll, solange man ihre Grenzen kennt.

Surfer ist exzellent für Spalte 1. Die Vollständigkeits-Hygiene, die Tools liefern, würde manuell Stunden pro Seite kosten. Wenn ich auf einen Klick die Top-Ten-SERP entitäten- und themenmäßig durchanalysieren lassen kann, ist das ein massiver Effizienzgewinn. Surfer ist auch gut für Erst-Briefings, um Autoren eine inhaltliche Mindestbreite vorzugeben.

Was Surfer nicht leistet — und auch nicht leisten kann, weil es algorithmisch ausgeschlossen ist — sind Spalte 2 und 3. Ein Tool, das aus dem SERP-Median rechnet, kann per Konstruktion nichts identifizieren, was im Median fehlt. Es kann nur das Sichtbare optimieren, nicht das Unsichtbare ergänzen.

Der korrekte Workflow ist also: Surfer für die Hygiene, dann manuelle redaktionelle Arbeit für die Position. Wer beim Surfer-Score 99 aufhört, hat erst die Hälfte gemacht — und genau diese Hälfte ist die, die im AI-Zeitalter nicht mehr ausreicht. Position 14 war für unsere München-Seite kein Pech und kein technisches Problem. Es war das exakte Ergebnis dessen, dass wir nur die erste Hälfte gemacht hatten.

Die zweite Konkurrenz-Ebene: SEO ≠ GEO

Eine Pointe, die in der klassischen Wettbewerbsanalyse oft übersehen wird: Die Liste der Domains, die in AI Overviews, ChatGPT, Perplexity oder Gemini für dein Thema zitiert werden, ist häufig nicht identisch mit den Top-10-Rankern der klassischen SERP. AI-Systeme bevorzugen — wie oben beschrieben — Quellen mit Position, mit eigenen Daten, mit Spezifika. Das sind oft kleinere, fachlich tiefere Seiten, die im klassischen Sichtbarkeitsindex weiter unten liegen. Warum das so ist, und wie sich die drei Optimierungsebenen SEO, AEO und GEO unterscheiden, habe ich an anderer Stelle ausführlicher behandelt.

Für eine seriöse Wettbewerbsanalyse heißt das: zwei Wettbewerbslisten führen. Die klassische SERP-Konkurrenz und die AI-Zitations-Konkurrenz. Tools wie Rankscale machen das systematisch. Wer nur eine der beiden Listen kennt, hat einen blinden Fleck — entweder gegen den klassischen Traffic oder gegen die AI-Sichtbarkeit. Die Commodity-Falle wirkt auf beiden Ebenen, aber sie greift in der AI-Suche härter und schneller, weil dort Redundanz härter bestraft wird. Wer den Wandel in seiner ganzen Tragweite verstehen will, findet in unserem Guide zu GEO und SEO 2026 die strategische Gesamtsicht.

Was das für dich heißt

Die Commodity-Falle ist nur ein Aspekt eines größeren Verschiebungsprozesses. Wer sie ignoriert, optimiert in einen Markt, den es so bald nicht mehr gibt. Was wir aus unserer eigenen Erfahrung mit Position 14 mitgenommen haben, lässt sich in drei Sätzen zusammenfassen: Identifiziere die richtigen Konkurrenten weiterhin systematisch. Analysiere sie aber nicht als Vorlage, sondern als Gap-Diagnose. Und investiere die freigewordene Energie in die Stellen, an denen du eine Position einnehmen kannst, die kein anderer einnimmt.

Das ist auch genau die Linie, die Salome in Modernes SEO bereits gezogen hat — vom Keyword zum tatsächlichen Problem des Nutzers. Und es ist die andere Hälfte des Punkts aus SEO ist 2026 tot?: Brand-Signale und Vertrauen entstehen, indem du Inhalte produzierst, die nicht jeder produzieren kann. Tools können dir helfen, schneller zu sein. Sie können dir nicht helfen, einzigartig zu sein.

Wenn du wissen willst, wo deine eigene Seite in dieser Logik steht — auf welcher Spalte du gerade optimierst, und ob deine Wettbewerbsanalyse dich zur Position oder zum Median führt — sprich uns an. Diagnose vor Therapie. Wir machen das seit 2016 mit unserer eigenen SEO-Agentur in München — und wie du in diesem Artikel gelesen hast, mit ehrlicher Reflexion über die Methode selbst. Den Surfer-Score können wir hinterher überprüfen.