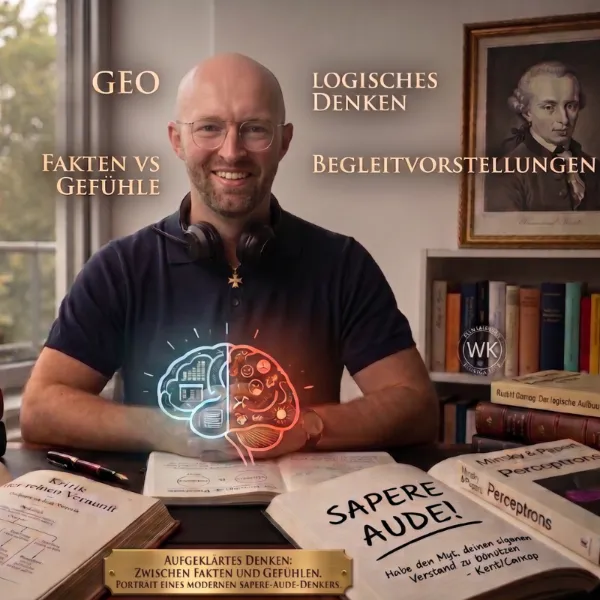

Wer mich kennt, weiß: Bevor ich SEO gemacht habe, habe ich Philosophie studiert. Und das ist kein abgeschlossenes Kapitel. Ich beschäftige mich bis heute mit philosophischen Fragestellungen – auch außerhalb meiner Agenturarbeit, in akademischen Kolloquien und im Austausch mit Forschenden. Wer meinen Artikel über Aristoteles’ Goldene Mitte und SEO gelesen hat, ahnt, dass Philosophie und Suchmaschinenoptimierung für mich keine Gegensätze sind.

In einem dieser akademischen Zusammenhänge bin ich auf eine Analyse gestoßen, die mich nicht mehr losgelassen hat. Nicht weil sie neu wäre – sie stammt aus dem Jahr 1928. Sondern weil sie ein Werkzeug liefert, das sich erstaunlich präzise auf den aktuellen KI Hype und die damit verbundenen Debatten anwenden lässt.

200+

5,0

zufriedene Kunden

Das Werkzeug stammt von Rudolf Carnap, einem der wichtigsten Denker des Wiener Kreises. In seiner Schrift Scheinprobleme in der Philosophie entwickelt Carnap eine systematische Methode, um Aussagen in ihre Bestandteile zu zerlegen – und dabei sichtbar zu machen, wo eine Aussage tatsächlich Fakten transportiert und wo sie lediglich Vorstellungen in unseren Köpfen erzeugt. Die Unterscheidung klingt banal. In der Praxis ist sie alles andere als das. Sie betrifft nicht nur die KI-Debatte, sondern auch die Art, wie Marketing funktioniert, wie wir Suchanfragen formulieren und wie wir mit KI-Systemen interagieren. Dazu komme ich gleich.

Inhalt dieser Seite

Wie Carnap Aussagen zerlegt

Carnap trennt bei jeder Aussage zwei Ebenen.

Auf der einen Seite steht der theoretische Gehalt: das, was tatsächlich überprüfbar ist, was prinzipiell wahr oder falsch sein kann.

Auf der anderen Seite stehen die sogenannten Begleitvorstellungen – das, was beim Lesen oder Hören einer Aussage unweigerlich in uns entsteht, aber nicht in der Aussage selbst steckt.

Den theoretischen Gehalt zerlegt Carnap weiter. Es gibt einen Kern – den tragenden, beweisbaren Teil – und einen Nebenteil, der logisch entbehrlich ist, aber trotzdem zur Aussage gehört. Der Nebenteil kann eine Hypothese sein, eine Verallgemeinerung, eine Einschätzung. Sachhaltig ist er dann, wenn er sich zumindest prinzipiell überprüfen lässt. Aber eben: noch nicht überprüft.

Die Begleitvorstellungen teilt Carnap nochmals. Es gibt Sachverhaltsvorstellungen, die man theoretisch in die Aussage aufnehmen könnte – die also selbst überprüfbar wären. Und es gibt Gegenstandsvorstellungen:

Gefühle

Stimmungen

Assoziationen

Pessimismus

Euphorie

Angst

Die können nie Teil einer überprüfbaren Aussage werden. Aber sie bestimmen, wie wir auf eine Aussage reagieren. Und genau hier wird es relevant.

Was Marketing mit Carnap zu tun hat

An dieser Stelle muss ich etwas eingestehen, das auf den ersten Blick wie ein Widerspruch wirkt. Marketing – und damit auch ein Teil meiner täglichen Arbeit – funktioniert genau über diesen Mechanismus. Gutes Marketing erzeugt Vorstellungen im Kopf der Zielgruppe, die über den reinen Sachverhalt hinausgehen. Das ist kein Betrug, sondern das Grundprinzip jeder Kommunikation, die zum Handeln bewegen soll. Wenn ich schreibe „Diagnose vor Therapie“ oder „Nach der Unterschrift fängt unsere Arbeit an“, dann sind das keine überprüfbaren Fakten im Carnap’schen Sinne. Es sind bewusst erzeugte Begleitvorstellungen – sie sollen Vertrauen, Seriosität und Verbindlichkeit hervorrufen. Und das ist auch in Ordnung, solange klar ist, was davon der sachhaltige Kern ist und was die bewusst erzeugte Vorstellung.

Das Problem beginnt dort, wo die Grenze zwischen Sachgehalt und Vorstellung absichtlich verwischt wird – oder wo der Empfänger nicht mehr in der Lage ist, beides zu unterscheiden. Und genau das passiert in der aktuellen KI-Debatte auf breiter Front.

Wie dieses Werkzeug schon einmal eine KI-Debatte entlarvt hat

Dass Carnaps Analyse keine bloße Theorie ist, zeigt ein konkretes historisches Beispiel aus der KI-Forschung selbst. In den 1960er Jahren tobte ein Streit zwischen zwei Lagern: den Konnektionisten um Frank Rosenblatt, die an neuronale Netze glaubten, und den Vertretern der symbolischen KI um Marvin Minsky. 1969 veröffentlichten Minsky und sein Kollege Seymour Papert das Buch Perceptrons, in dem sie mathematisch bewiesen, dass einfache neuronale Netze bestimmte Probleme nicht lösen können.

Der Kern dieser Arbeit war korrekt und sachhaltig. Die Mathematik stimmte. Kein Scheinproblem. Aber Minsky und Papert taten mehr als beweisen. Sie formulierten pessimistische Hypothesen darüber, dass auch komplexere neuronale Netze an denselben Grenzen scheitern würden. Das war der Nebenteil – prinzipiell überprüfbar, aber zum damaligen Zeitpunkt unbewiesen. Und dieser Nebenteil stellte sich Jahre später als falsch heraus, als mehrschichtige Netzwerke und Backpropagation genau die Probleme lösten, die Minsky und Papert für unlösbar gehalten hatten.

Die eigentliche Pointe liegt aber woanders. Der massive historische Effekt – der sogenannte AI Winter, das Einbrechen der Forschungsgelder, das Brachliegen eines ganzen Forschungszweiges über fast zwei Jahrzehnte – kam weder aus dem Kern noch aus dem Nebenteil. Er kam aus den Begleitvorstellungen. Minsky und Papert hatten durch ihre Wortwahl, durch die Art, wie sie Beispiele rahmten, durch den Ton ihrer Argumentation etwas erzeugt, das sich nicht mathematisch beweisen lässt: Pessimismus und Zweifel am gesamten Forschungsfeld. Das ist eine Gegenstandsvorstellung – nicht überprüfbar, nicht sachhaltig, aber wirksam genug, um eine reale Grenze zu ziehen.

Carnap selbst hat diesen Mechanismus explizit beschrieben: Wir können begleitende Vorstellungen gezielt hervorrufen, „durch die Wahl geeigneter Namen für Begriffe oder durch die Wahl einer geeigneten Sprachform für die ganze Aussage“. Genau das haben Minsky und Papert getan. Die Grenze, die sie zogen, war nicht mathematisch. Sie war rhetorisch-psychologisch. Das ist dieselbe Mechanik, die im Marketing funktioniert – nur dass dort die Absicht transparent ist und im wissenschaftlichen Kontext eben nicht.

Was das mit der heutigen KI-Debatte zu tun hat

Wenden wir Carnaps Werkzeug auf die Diskussion an, die 2026 jeden zweiten LinkedIn-Post dominiert, wird ein Muster sichtbar – und zwar auf beiden Seiten.

Wenn Stephen Hawking vor einer existentiellen Bedrohung durch KI warnte oder Elon Musk regelmäßig vor Superintelligenz warnt, dann gibt es einen sachhaltigen Kern: Ja, KI-Systeme werden leistungsfähiger. Ja, bestimmte Fähigkeiten übertreffen menschliche Leistung in spezifischen Domänen. Das sind überprüfbare Aussagen. Aber der Sprung von „GPT kann Texte generieren“ zu „KI wird die Menschheit auslöschen“ ist kein Kern und kein Nebenteil. Das ist eine Gegenstandsvorstellung. Sie erzeugt Angst, Faszination, Handlungsdruck. Aber sie ist nicht überprüfbar.

Dasselbe Muster funktioniert in die andere Richtung genauso. Wenn Tech-Unternehmen versprechen, KI werde alle Probleme lösen, Kreativität demokratisieren und eine neue Ära des Wohlstands einleiten, dann steckt da ebenfalls ein sachhaltiger Kern drin – bestimmte Prozesse werden effizienter, bestimmte Zugänge werden niedrigschwelliger. Aber die utopische Begleitvorstellung ist genauso wenig sachhaltig wie die dystopische. Beide Seiten instrumentalisieren Gegenstandsvorstellungen. Und beide profitieren davon: Angst generiert Aufmerksamkeit und Regulierungsbudgets, Euphorie generiert Investitionen und Adoption.

Was in der Debatte regelmäßig fehlt, ist der Schritt zurück: Was genau ist hier der überprüfbare Kern? Was ist eine Hypothese, die sich noch beweisen muss? Und was ist eine Vorstellung, die jemand in meinem Kopf erzeugen will – ob bewusst oder unbewusst?

Was sich in der Suche tatsächlich verändert hat – und was daraus gemacht wird

Bevor ich Carnaps Werkzeug auf die GEO-Debatte anwende, muss ich erst skizzieren, worum es dabei überhaupt geht. Denn auch hier vermischen sich bereits in der Darstellung Kern und Vorstellung.

Seit März 2025 zeigt Google in Deutschland sogenannte AI Overviews – KI-generierte Zusammenfassungen, die oberhalb der klassischen Suchergebnisse eingeblendet werden. Im Oktober 2025 folgte der Google AI Mode als eigenständiger Suchmodus, in dem Nutzer konversational mit Googles Gemini-Modell recherchieren können. Parallel dazu hat sich ChatGPT zu einer ernstzunehmenden Suchalternative entwickelt. Perplexity, Microsoft Copilot und andere KI-Suchsysteme ergänzen das Bild. Das sind Fakten – überprüfbar, messbar, dokumentiert.

Was daraus folgt, ist die Frage, die die Branche unter dem Begriff GEO diskutiert: Wenn KI-Systeme Antworten generieren, statt nur Links zu zeigen – wie sorge ich dann dafür, dass meine Inhalte als Quelle in diesen Antworten auftauchen? Generative Engine Optimization beschreibt also die Optimierung von Inhalten nicht mehr nur für klassische Suchmaschinen-Rankings, sondern auch für die Sichtbarkeit in KI-generierten Antworten. Wer sich für die Abgrenzung der verschiedenen Begriffe interessiert: Den Unterschied zwischen GEO, AEO und klassischem SEO habe ich in einem eigenen Artikel aufgeschlüsselt.

So weit der sachhaltige Kern. Die Veränderung ist real, die Frage ist berechtigt, und es gibt bereits erste Daten und Methoden, mit denen sich Sichtbarkeit in KI-Systemen analysieren und beeinflussen lässt.

Jetzt zum Nebenteil. Hier stehen wir bei vielen Fragen noch auf dünnem Eis. Wie stark wirkt sich die KI-Suche tatsächlich auf organischen Traffic aus? BrightEdge berichtet von Impressionssteigerungen bei gleichzeitigem CTR-Rückgang – aber die Datenlage ist noch fragmentärisch und stark branchenabhängig. Welche Faktoren dazu führen, dass ein LLM eine bestimmte Quelle zitiert und eine andere nicht, ist ebenfalls noch nicht abschließend verstanden. Es gibt erste Erkenntnisse – Autorität, Zitierfähigkeit, strukturierte Daten und Entity SEO spielen offenbar eine Rolle. Aber vieles davon sind begründete Hypothesen, keine bewiesenen Kausalitäten. Das ist wissenschaftlich völlig in Ordnung. Es muss nur als solches benannt werden.

Und dann sind da die Begleitvorstellungen, die auf beiden Seiten der Debatte erzeugt werden.

Auf der einen Seite: „Wer nicht in AI Overviews auftaucht, existiert für seine Kunden nicht.“ „SEO ist tot – GEO ist die Zukunft.“ „Du brauchst sofort eine KI-Sichtbarkeitsstrategie oder du verlierst alles.“ Diese Sätze sind nicht sachhaltig im Carnap’schen Sinne. Sie sind nicht als wahr oder falsch überprüfbar, weil sie als absolute Aussagen formuliert sind, die keinen Überprüfungsrahmen haben. Aber sie erzeugen Dringlichkeit, Angst und FOMO – und das treibt Budgetentscheidungen.

Auf der anderen Seite gibt es die Gegenbewegung: „GEO ist nur ein neues Buzzword für altes SEO.“ „AI Overviews haben kaum Auswirkungen auf den Traffic.“ „Das ist alles nur Hype.“ Auch das sind Gegenstandsvorstellungen – sie erzeugen Beruhigung und das Gefühl, nichts tun zu müssen.

Beides ist nicht hilfreich. Die Realität liegt, wie meistens, dazwischen – und um sie zu finden, muss man Kern, Nebenteil und Begleitvorstellung auseinanderhalten.

Warum Suchintention und Prompting dasselbe Problem haben

Dieser Gedanke lässt sich weiterdrehen – in ein Feld, das mir beruflich näher liegt als die große KI-Philosophie. Denn die Unterscheidung zwischen Sachgehalt und Begleitvorstellung betrifft nicht nur das, was über KI gesagt wird. Sie betrifft auch, wie wir mit KI interagieren.

Wer als SEO mit Suchintentionen arbeitet, kennt das Phänomen: Hinter jeder Suchanfrage steckt mehr als die eingetippten Wörter. Da gibt es den sachlichen Kern – die Information, die jemand sucht. Und es gibt die Begleitvorstellungen, die die Formulierung transportiert. Jemand, der „beste SEO Agentur München“ googelt, sucht sachlich nach einem Dienstleister. Die Begleitvorstellung aber ist: Bestätigung, Sicherheit, die Vorstellung, dass es eine objektiv beste Agentur gibt und dass Google sie kennt. Diese Vorstellung ist nicht sachhaltig – sie kann nicht wahr oder falsch sein. Aber sie bestimmt, welches Ergebnis den Klick bekommt. Wer im Marketing arbeitet, gestaltet genau diese Ebene mit: Title Tags, Descriptions, Landingpages – sie alle arbeiten mindestens so sehr mit Begleitvorstellungen wie mit Sachgehalt.

Beim Prompting von KI-Systemen zeigt sich dasselbe Muster, nur in umgekehrter Richtung. Wenn jemand ChatGPT fragt „Ist SEO 2026 tot?“, dann formuliert der Prompt eine Gegenstandsvorstellung als Frage. Der sachhaltige Kern wäre: „Wie verändert sich organischer Traffic durch AI Overviews?“ Aber die Vorstellung – SEO als sterbende Disziplin – ist bereits in der Frage eingebaut. Und das beeinflusst die Antwort, weil das Sprachmodell auf die Vorstellung reagiert, nicht nur auf den Sachgehalt. Ein präziser Prompt, der den Kern einer Frage isoliert, liefert eine präzisere Antwort. Ein Prompt, der voller Begleitvorstellungen steckt, liefert eine Antwort, die diese Vorstellungen bestätigt oder widerspiegelt. Für viele Menschen ist genau das der blinde Fleck im Umgang mit KI: Sie verwechseln die Vorstellung, die sie in den Prompt hineinlegen, mit dem Ergebnis, das sie herausbekommen – und halten beides für Fakt.

Warum viele Menschen KI deshalb falsch einschätzen

Damit sind wir bei dem, was ich für eines der zentralen Probleme im Umgang mit KI halte. Es ist nicht die Technologie selbst. Es ist die fehlende Übung, zwischen dem sachhaltigen Kern einer KI-Ausgabe und den Begleitvorstellungen zu unterscheiden, die sie erzeugt.

Wenn ein LLM eine Antwort gibt, hat diese Antwort einen Kern: die Information, die aus den Trainingsdaten destilliert wurde. Ob dieser Kern korrekt ist, lässt sich überprüfen – zumindest prinzipiell. Aber die Antwort transportiert gleichzeitig massive Begleitvorstellungen: den autoritativen Ton, die scheinbare Vollständigkeit, die grammatische Sicherheit, die Struktur, die suggeriert – hier ist alles gesagt, hier ist ein Experte am Werk. Diese Vorstellungen sind nicht sachhaltig. Die KI hat keine Autorität, keine Expertise, kein Urteilsvermögen. Aber die Begleitvorstellungen erzeugen genau diesen Eindruck. Und weil die meisten Nutzer weder die Quellen kennen noch die Methode hinterfragen, reagieren sie auf die Vorstellung, nicht auf den Kern.

Das ist strukturell exakt dasselbe Problem, das Minsky und Papert 1969 erzeugt haben – nur skaliert auf Millionen von täglichen Interaktionen. Die Grenze, die ein Sprachmodell zieht, ist nicht die Grenze des Wissens. Es ist die Grenze der Vorstellung, die das Modell in dir erzeugt. Und wenn du diese Grenze nicht erkennst, triffst du Entscheidungen auf Basis von Gegenstandsvorstellungen, die du für Fakten hältst.

Warum wir das hier transparent machen – und warum wir als Agentur aufklären

An dieser Stelle muss ich etwas erklären, das in der Agenturbranche ungewöhnlich ist. Die meisten Dienstleister hätten kein Interesse daran, ihren Kunden ein Werkzeug an die Hand zu geben, mit dem sie Marketing-Aussagen zerlegen können – auch die der eigenen Agentur. Wir machen das trotzdem, und zwar bewusst.

Der Grund ist einfach: Viele Unternehmer kommen zu uns, weil sie verunsichert sind. Nicht weil ihre Geschäfte schlecht laufen, sondern weil die Marktdynamik ihnen Angst macht. Sie lesen „SEO ist tot“, hören von AI Overviews, sehen Konkurrenten, die in KI-Tools investieren, und spüren einen Handlungsdruck, den sie nicht einordnen können. Genau das ist die zweite Ebene, über die wir den ganzen Artikel lang sprechen:

Diese Angst ist keine Reaktion auf den sachhaltigen Kern der Veränderung. Sie ist eine Begleitvorstellung, die durch das Framing der Debatte erzeugt wurde. Und auf dieser Angst Geschäfte aufzubauen, wäre das Instrumentalisieren von Gegenstandsvorstellungen – exakt das, was Carnap beschrieben hat.

Wir verstehen uns als Agentur, die aufklärt. Das klingt groß, meint aber etwas ganz Konkretes:

- Wenn du zu uns kommst, sagen wir dir, was der sachhaltige Kern der Veränderung ist – und was nicht.

- Wir erklären, was SEO tatsächlich leistet und wo seine Grenzen liegen.

- Wir zeigen, welche Daten belastbar sind und welche Hypothesen noch offen.

- Und wir helfen dir, die Begleitvorstellungen zu identifizieren, die deine Entscheidungen unbewusst steuern – damit du auf Basis von Fakten entscheidest, nicht auf Basis von Angst.

Unser Anspruch war von Anfang an, dass informierte Kunden die besseren Kunden sind. Nicht weil das eine nette Floskel wäre, sondern weil es in der Praxis stimmt. Wer versteht, wo in einer Aussage der Kern aufhört und die Begleitvorstellung anfängt, trifft bessere Entscheidungen. Und bessere Entscheidungen führen zu besserer Zusammenarbeit – weil die Erwartungshaltung auf dem basiert, was tatsächlich leistbar und belegbar ist, nicht auf einer Vorstellung, die jemand verkaufsgetrieben erzeugt hat.

Konkret: Wir bieten GEO als Leistung an. Wir könnten also mit den gleichen Begleitvorstellungen arbeiten, die der Rest der Branche nutzt – „Ohne GEO existierst du für deine Kunden nicht mehr“, „Wer jetzt nicht handelt, verliert alles.“ Das würde kurzfristig Druck erzeugen und vermutlich schnellere Abschlüsse bringen. Aber es wäre nicht sachhaltig. Es wäre das Instrumentalisieren von Gegenstandsvorstellungen. Wir wollen, dass du zu uns kommst, weil du den sachlichen Kern der Veränderung verstehst und darauf aufbauend eine fundierte Entscheidung triffst. Nicht weil dich jemand in Panik versetzt hat.

Deshalb dieser Artikel. Er ist nicht „trotz“ unserer Rolle als Agentur entstanden, sondern genau wegen ihr. Transparenz darüber, wo die Grenze zwischen Fakt und Framing verläuft, ist kein Widerspruch zum Marketing – sie ist die ehrlichere Form davon.

200+

5,0

zufriedene Kunden

Was bleibt

Carnaps Werkzeug ist fast hundert Jahre alt. Aber es funktioniert, weil das Problem nicht technologisch ist, sondern menschlich. Wir reagieren auf Vorstellungen, als wären sie Fakten. Das war 1969 so, als ein ganzer Forschungszweig wegen Begleitvorstellungen zum Erliegen kam. Und das ist 2026 so, wenn ein Unternehmer in Panik sein gesamtes Marketing umstellt, weil jemand überzeugend genug „SEO ist tot“ gesagt hat – oder wenn ein anderer blind jeder KI-Empfehlung folgt, weil der Output so autoritativ klang.

Die Aufgabe ist letztlich dieselbe, die Kant vor über zweihundert Jahren formuliert hat: Sapere aude – habe den Mut, dich deines eigenen Verstandes zu bedienen. Oder etwas pragmatischer ausgedrückt: Bevor du auf eine Aussage reagierst, frag dich, ob du auf den Kern reagierst oder auf die Vorstellung, die jemand in dir hervorrufen wollte. Das gilt für KI-Prognosen, für Marketing-Versprechen, für Suchmaschinen-Ergebnisse – und für die nächste ChatGPT-Antwort, die du für bare Münze nimmst.

Und wenn du dir unsicher bist, wo in einer bestimmten Aussage der Kern aufhört und das Framing anfängt – sprich mit uns. Wir analysieren das gerne. Mit echten Daten, ehrlicher Einschätzung und ohne Panikmache.